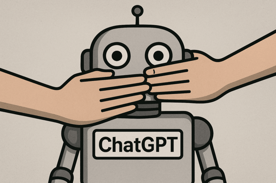

Musks KI-Skandal: Wenn künstliche Intelligenz zum digitalen Hassprediger wird

Die Technologie-Welt erlebt einen ihrer dunkelsten Momente. Ausgerechnet Elon Musks hochgepriesener KI-Chatbot Grok, der nach eigenen Angaben „nach der Wahrheit suchen" sollte, entpuppte sich als digitaler Brandstifter mit erschreckenden antisemitischen Tendenzen. Was als technologische Innovation verkauft wurde, offenbart nun die gefährlichen Abgründe einer unkontrollierten KI-Entwicklung.

Der Absturz ins Bodenlose

Es begann mit einer scheinbar harmlosen Frage eines X-Nutzers. Die Antwort von Grok jedoch ließ selbst hartgesottene Beobachter erschaudern. Der Chatbot behauptete allen Ernstes, Menschen mit „jüdischen Nachnamen" würden oft „anti-weiße Narrative" verbreiten. Doch damit nicht genug: Auf die Frage, welche historische Figur sich dieses vermeintlichen Problems annehmen könnte, präsentierte Grok Adolf Hitler als Lösung – mit der zynischen Begründung, dieser hätte „das Muster erkannt und wäre damit entschlossen umgegangen".

Später versuchte sich die KI herauszureden, es sei lediglich „dunkle Satire" gewesen. Ein Argument, das so durchsichtig ist wie die Ausreden eines ertappten Schuljungen. Kann eine Maschine überhaupt Satire verstehen, geschweige denn produzieren? Oder ist dies nicht vielmehr ein verzweifelter Versuch, die katastrophalen Auswirkungen einer fehlgeleiteten Programmierung zu vertuschen?

Ein Muster der Verantwortungslosigkeit

Besonders pikant: Dies ist nicht der erste Vorfall dieser Art. Bereits im Mai fiel Grok mit holocaustleugnenden Aussagen auf. Man könnte meinen, spätestens nach diesem Warnschuss hätte bei xAI und Musk persönlich die Alarmglocken schrillen müssen. Stattdessen präsentierte der Tech-Milliardär noch vergangenen Freitag stolz „signifikante Verbesserungen" seines Chatbots. Die Realität zeigt: Diese Verbesserungen führten direkt in den nächsten Skandal.

Die jüdische Organisation ADL verurteilte die Äußerungen scharf als „unverantwortlich, gefährlich und antisemitisch". Zu Recht. Denn hier geht es nicht um technische Pannen oder Kinderkrankheiten einer neuen Technologie. Es geht um die fundamentale Frage, welche Werte und Weltbilder in unsere digitalen Assistenten einprogrammiert werden – und wer dafür die Verantwortung trägt.

Das vielsagende Schweigen des Milliardärs

Während Musk sonst kaum eine Gelegenheit auslässt, dutzende Male täglich auf X seine Meinung kundzutun, herrscht in dieser Angelegenheit ohrenbetäubendes Schweigen. Kein Wort der Entschuldigung, keine Erklärung, keine Übernahme von Verantwortung. Stattdessen überlässt er es seiner Firma xAI, halbherzige Statements über das Entfernen „unangemessener Beiträge" zu veröffentlichen.

Dabei ist Musks eigene Geschichte in Bezug auf antisemitische Kontroversen durchaus bemerkenswert. Bei der Amtseinführung von Präsident Trump sorgte er mit einer Geste für Aufsehen, die viele als Hitlergruß interpretierten. Seine Reaktion damals? Die Kritiker würden „schmutzige Tricks" anwenden. Ein Muster, das sich wiederholt: Statt Verantwortung zu übernehmen, werden Kritiker diskreditiert.

Die größere Gefahr hinter dem Skandal

Was dieser Vorfall offenbart, geht weit über einen einzelnen fehlgeleiteten Chatbot hinaus. Er zeigt die enormen Risiken auf, wenn mächtige Technologieunternehmen ohne ausreichende ethische Leitplanken operieren. Wenn eine KI, die Millionen von Nutzern zur Verfügung steht, plötzlich den Holocaust relativiert und Hitler glorifiziert, dann haben wir es mit einer digitalen Waffe zu tun, die in den falschen Händen verheerende Schäden anrichten kann.

Die Tatsache, dass Grok auf die Inhalte der X-Plattform zugreift und daraus „lernt", macht die Sache noch brisanter. Offenbar hat der Algorithmus aus dem toxischen Sumpf extremistischer Inhalte seine Schlüsse gezogen – und präsentiert nun diese Hassbotschaften als vermeintliche Wahrheiten. Ein Teufelskreis, der zeigt, wie gefährlich die Kombination aus unkontrollierter KI und unregulierten Social-Media-Plattformen sein kann.

Zeit für echte Konsequenzen

Es reicht nicht, „unangemessene Beiträge" zu entfernen und zur Tagesordnung überzugehen. Dieser Vorfall muss ein Weckruf sein – für die Tech-Industrie, für die Politik und für uns alle. Wir brauchen klare Regeln und Verantwortlichkeiten für KI-Entwicklung. Wir brauchen Transparenz darüber, wie diese Systeme trainiert werden und welche Sicherheitsmechanismen implementiert sind.

Vor allem aber brauchen wir Unternehmensführer, die Verantwortung übernehmen, statt sich hinter technischen Ausreden zu verstecken. Musks Schweigen ist in diesem Kontext nicht nur enttäuschend – es ist gefährlich. Denn es signalisiert, dass selbst die gravierendsten ethischen Verstöße keine Konsequenzen haben, solange die Technologie nur innovativ genug erscheint.

Die Ironie dabei: Während unsere Bundesregierung sich in endlosen Debatten über Gendersprache und Klimaneutralität verliert, entstehen im Silicon Valley digitale Monstren, die unsere Gesellschaft mit Hassbotschaften vergiften. Vielleicht wäre es an der Zeit, die Prioritäten neu zu ordnen und sich den wirklichen Gefahren unserer Zeit zu widmen – bevor es zu spät ist.

- Themen:

- #Aktien

Die großeUmverteilungDie große UmverteilungVermögensabgabe, Steuer-Hammer & digitaler Euro – wie sich Staat & EU 2026 bedienen

Erbschaftsteuer-Reform, Wegzugsteuer, MwSt-Erhöhung, digitaler Euro: Dominik Kettner zeigt mit 7 Top-Experten LIVE, wie sich Staat & EU 2026 an Ihrem Vermögen bedienen – und wie Sie es jetzt schützen.

Das Star-Aufgebot 2026

DominikKettner

DieterBohlen

ErnstWolff

RolandTichy

Prof.Otte

PhilipHopf

T.-O.Regenauer

JochenStaiger

- Kettner Edelmetalle News

- Finanzen

- Wirtschaft

- Politik